Falcon-H1R 7B: Yeni Nesil LLM Yapay Zeka Modeli Sahnede

Açık kaynak ekosistemlerinde rekabet her geçen gün kızışırken, Falcon-H1R 7B modeli dikkat çekici bir alternatif olarak öne çıkmakta. Hem yerel kurulumlara hem de kurumsal uygulamalara optimize edilmiş bu model 7 milyar parametreye sahip.

Son dönemlerde kapasite miktarından kurulum kolaylığına, donanım özelliklerine ve gerçek dünya performanslarına odaklanılıyor. Falcon-H1R 7B, bu beklentilere yanıt vermek üzere tasarlanmış bir model. Ayrıca kod yazımı, özetleme, çok adımlı akıl yürütme ve kurumsal veri analizi gibi alanlarda yüksek doğruluk hedefliyor.

Falcon-H1R 7B’nin Teknik Özellikleri

Falcon-H1R 7B, transformer tabanlı mimari üzerine inşa ediliyor. Metin üretimi, özetleme, soru-cevap, kod yazımı gibi görevlerde yüksek doğruluk oranı hedeflemekte. Model optimize edilmiş mekanizması sayesinde daha düşük bellek kapasitesiyle çalışabiliyor.

Öne çıkan teknik özellikleri ise;

- 7 milyar parametre

- Geliştirilmiş attention optimizasyonu

- Düşük VRAM ile çalışabilme

- Yerel inference performansına uygun yapı

- Fine-tuning desteği

Bu özellikler sayesinde, Falcon-H1R 7B, hem bireysel kullanıcılar hem de küçük orta ölçekli işletmeler kolaylıkla kullanabilmektedir.

Falcon-H1R 7B Kurulumu Nasıl Yapılır?

Falcon-H1R 7B kurulumu teknik altyapı sahibi kullanıcılar için oldukça yönetilebilir bir yapıya sahip. Tabi ki doğru yapılandırma da performans açısından kritik önem taşımakta.

- Donanım Kurlumu: Minimum olarak bilgisayarda 16GB Ram(bellek) önerilirken, ekran kartı tarafında ise 8 Gb Vram tavsiye edilir. Bu donanıma bakıldığında artık ortalama bilgisayarlarda rahatlıkla bulunabilir özellikler.

- Ortam Kurulumu: Phton 3.10 sürümü veya daha üst sürüm kurulmalıdır. Daha sonra PyTorch veya benzeri framework yüklenmeli. Ekran kartı hızlandırma içinse Cuda uyumluluğu kontrol edilmeli.

- Model İndirme: Bu tür dosyalar genellikle Hugging Face gibi açık kaynak platformlardan elde edilebilir. Ardından kütüphane üzerinden yüklenir.

- Çalıştırma ve Test: Inference(top-p,max_tokens gibi) parametreleri optimize edilerek model test edilir. Vram kullanımını izlemek performans açısından önemlidir.

Kurulum tamamlandığında Falcon-H1R 7B, internet bağlantısına ihtiyaç duymadan yerel sistem olarak çalışacaktır.

Falcon-H1R vs Llama 3: Performans Karşılaştırma

| Kriter | Falcon-H1R 7B | Llama 3 |

|---|---|---|

| Parametre Sayısı | 7 milyar | 8B, 70B (ve üzeri varyantlar) |

| Mimari Yapı | Optimize edilmiş transformer | Gelişmiş transformer (Meta optimizasyonlu) |

| Donanım Gereksinimi | Orta seviye GPU (8–12 GB VRAM yeterli) | 8B için orta-üst, 70B için yüksek seviye GPU / sunucu |

| Bellek Tüketimi | Daha düşük VRAM kullanımı | Parametre arttıkça yüksek VRAM ihtiyacı |

| Yerel Kurulum Kolaylığı | Daha erişilebilir ve hafif | Büyük modeller için daha karmaşık |

| Quantization Desteği | 4-bit / 8-bit verimli çalışır | Destekler ancak büyük modellerde hâlâ yüksek kaynak tüketir |

| Inference Hızı | Düşük latency, dengeli performans | Büyük modellerde daha yüksek doğruluk, daha fazla işlem süresi |

| Fine-Tuning Maliyeti | Daha düşük donanım maliyeti | Büyük varyantlarda maliyet artar |

| Edge Deployment | Daha uygun | Sınırlı (küçük varyantlar hariç) |

| Kurumsal Kullanım | KOBİ ve yerel veri analizi için ideal | Büyük ölçekli kurumsal projelerde güçlü |

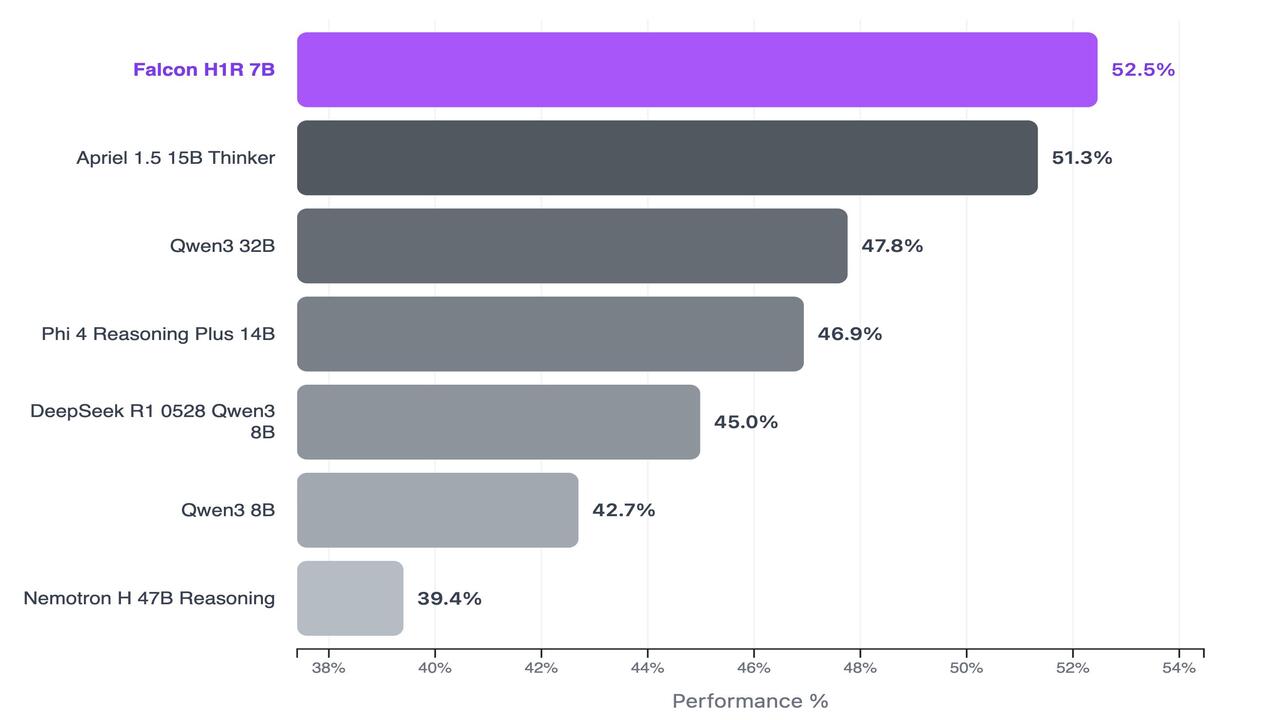

| Benchmark Performansı | Dengeli ve optimize edilmiş | Üst segment varyantlarda daha yüksek skor |

LLM Yapay Zeka Trendleri ve Falcon-H1R’nin Konumu

2026 yılı içerisinde LLM yapay zeka alanında üç ana trend öne çıkmakta; Yerel model çalıştırma, model optimizasyonu ve kurumsal özelleştirme. Falcom-H1R 7B özellikle iki başlıkta güçlü bir pozisyon aldığını söyleyebiliriz. Hafifletilmiş mimarisi sayesinde bir çok cihazda sorunsuz çalışabilmekte.

Öte yandan Hybird Transformer-Mamba gibi hibrit mimariler Falcon-H1R 7B segmentinde ki modeller için kritik hale geliyor. Bu yaklaşım Mamba tabanlı state space(durum uzayı) modellerinin verimlilik avantajı ile birleştiren karışım bir yapıdır. Bu sayede LLM, yapay zeka alanında performans ve verimlilik dengesini optimize etmeyi hedefler.

Mamba mimarisi, sıralı veri akışını lineer yani düzlemsel karmaşıklıkla işler. Bu da uzun bağlamlı dizilerde ciddi performans artışı sağlar. Hybird Transformer-Mamba mimarisinin özellikleri ise, daha düşük bellek tüketimi, uzun sekanslarda yüksek verimlilik, daha düşük gecikme süreleri ve donanım dostu yapısı gibi etkiler söylenebilir. Tabii ki bu yaklaşımın tek başına bağlamsal ilişki modellemesi sunamadığı senaryolar da bulunur.

Gelecek Perspektifi: Verimlilik Odaklı LLM Dönemi

LLM yarışında yalnızca parametre büyüklüğü yeterli olmuyor. Tüm bunların yanında artık 2026 yılında, verimlilik ve donanım optimizasyonu da en çok üstüne düşülen konuların başında geliyor. Falcon-H1R 7B, bu dönüşümün temsilcilerinden biri olarak konumlanmakta. Bu model, yüksek performansı donanım tasarrufu ile bir araya getirirken kurumsal ve kobiler için sürdürülebilir LLM çözümleri sunmakta. Önümüzdeki dönemde LLM rekabeti daha erişilebilir ve özelleştirilebilir çözümler sunarak pazarı şekillendirecek. Falcon-H1R, yeni yeni paradigmanın üyesi olarak dikkat çekmekte.

Yorumlar (0)

Yorum yapmak için giriş yapmalısınız.

Giriş Yap