Titans ve MIRAS: AI Uzun Süreli Bellek Sorununu Çözüyor

Yapay zeka dünyasında, özellikle büyük dil modellerinin (LLM) en büyük darboğazı, devasa veri yığınlarını işlerken geçmiş bilgileri unutması veya bu bilgileri hatırlamanın maliyetinin astronomik seviyelere ulaşmasıdır. Google Research ekibi tarafından tanıtılan Titans mimarisi ve MIRAS çerçevesi, "test-time memorization" (test anında ezberleme) yeteneğiyle AI Uzun Süreli Bellek sorununa kalıcı bir çözüm getirmeyi vaat ediyor.

Bu yeni teknoloji, standart Transformer modellerinin aksine, çalışırken bellek parametrelerini aktif olarak güncelleyerek milyonlarca tokenlık bağlamı (context) kayıpsız ve yüksek hızda işleyebiliyor. Bu makalede, Titans ve MIRAS'ın teknik derinliğini, yapay zekanın sıralı modelleme yeteneğini nasıl dönüştürdüğünü ve bu inovasyonun akademik kaynaklara dayanan detaylarını inceleyeceğiz.

Titans ve MIRAS Nedir? Teknik Temeller ve Yenilikler

Geleneksel Transformer mimarisi, "attention" (dikkat) mekanizmasıyla mükemmel bir kısa süreli bellek sunar; ancak dizi uzunluğu arttıkça hesaplama maliyeti karesel olarak artar. Google araştırmacıları Ali Behrouz, Meisam Razaviyayn ve Vahab Mirrokni tarafından 4 Aralık 2025'te duyurulan bu çalışma, RNN'lerin (Yinelemeli Sinir Ağları) hızını Transformer'ların doğruluğuyla birleştiriyor.

- Titans Mimarisi: Bu, sistemin "fiziksel" aracıdır. Sabit boyutlu geleneksel RNN belleklerinin aksine Titans, derin bir sinir ağı (çok katmanlı algılayıcı - MLP) kullanarak geçmiş verileri özetler.

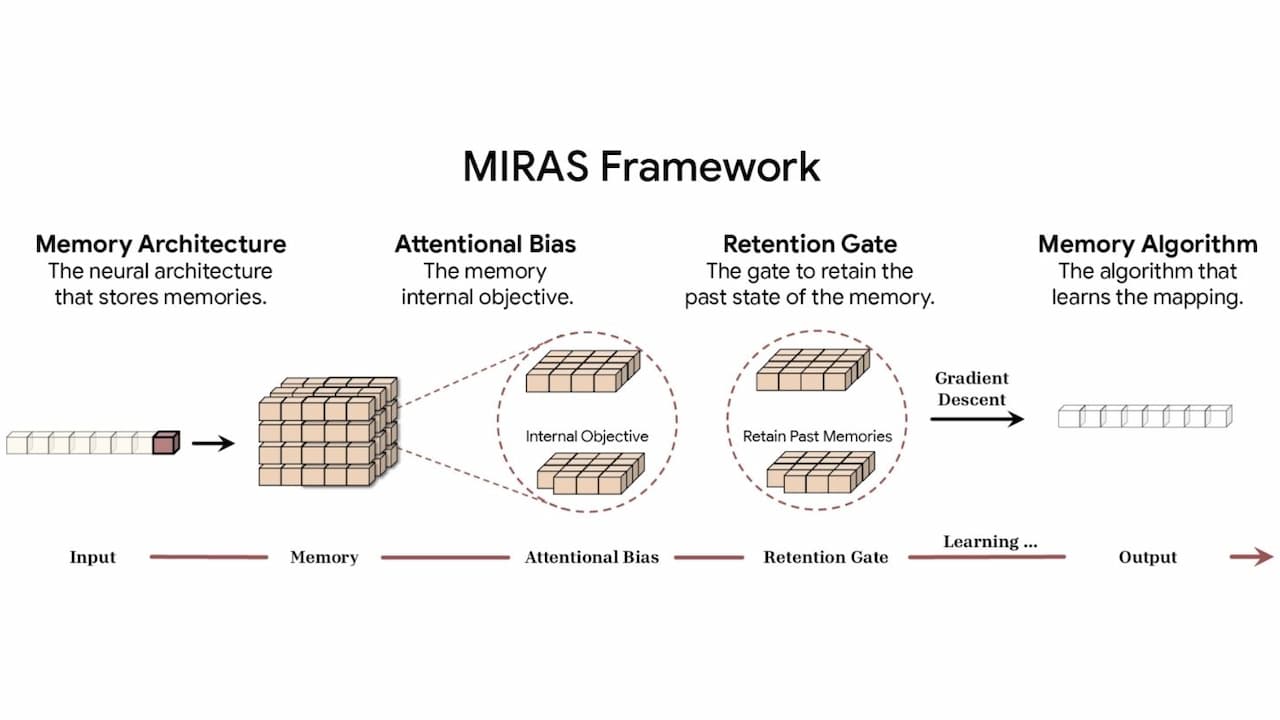

- MIRAS Çerçevesi: MIRAS (blueprint), bu yaklaşımları genelleştirmek için geliştirilmiş teorik bir çerçevedir. Sıralı modellemeyi bir "ilişkisel bellek" (associative memory) problemi olarak tanımlar ve bellek mimarisi, dikkat yanlılığı (attentional bias), tutma kapısı (retention gate) ve bellek algoritması olmak üzere dört ana bileşene ayırır.

Titans Nasıl Çalışır? "Sürpriz Metriği" ile Aktif Öğrenme

Titans'ı benzersiz kılan şey, veriyi pasif bir şekilde depolamak yerine aktif olarak neyi hatırlaması gerektiğini öğrenmesidir. Bu süreçte insan psikolojisindeki "beklenmedik olayları hatırlama" eğilimi matematiksel bir modele dönüştürülmüştür.

- Sürpriz Metriği (Surprise Metric): Model, gelen yeni veri ile mevcut bellek durumu arasındaki farkı (gradyanı) ölçer. Eğer veri beklenen bir kalıba uyuyorsa (düşük sürpriz), bellek güncellenmez. Ancak veri beklenmedikse (yüksek sürpriz), bu bilgi "önemli" olarak işaretlenir ve uzun süreli belleğe öncelikli olarak kaydedilir.

- Momentum ve Unutma Kapısı: Titans, sadece o anki sürprizi değil, geçmişteki sürpriz akışını da dikkate alan bir momentum mekanizması kullanır. Ayrıca, sınırlı bellek kapasitesini yönetmek için artık ihtiyaç duyulmayan bilgileri atan bir uyarlanabilir ağırlık bozunması (forgetting gate) uygular.

MIRAS Çerçevesi: MSE Paradigmasının Ötesine Geçiş

Mevcut modellerin çoğu, veriyi karşılaştırırken Hata Kareler Ortalaması (MSE) veya nokta çarpım benzerliği gibi standart yöntemlere dayanır. MIRAS, bu kısıtlamayı aşarak "Öklid dışı hedefler" ve yeni düzenleme (regularization) biçimleri sunar. Bu çerçeve kapsamında üç özel model geliştirilmiştir:

- YAAD: Hatalara karşı daha dirençli (Huber kaybı kullanır), kirli veya tutarsız verilerde yüksek performans gösterir.

- MONETA: Daha disiplinli kurallar ve karmaşık matematiksel cezalar (genelleştirilmiş normlar) kullanarak istikrarlı bir uzun süreli bellek hedefler.

- MEMORA: Bellek stabilitesini en üst düzeye çıkarmak için belleği katı bir olasılık haritası gibi davranmaya zorlar.

Test-Time Memorization ve Performans Sonuçları Nelerdir?

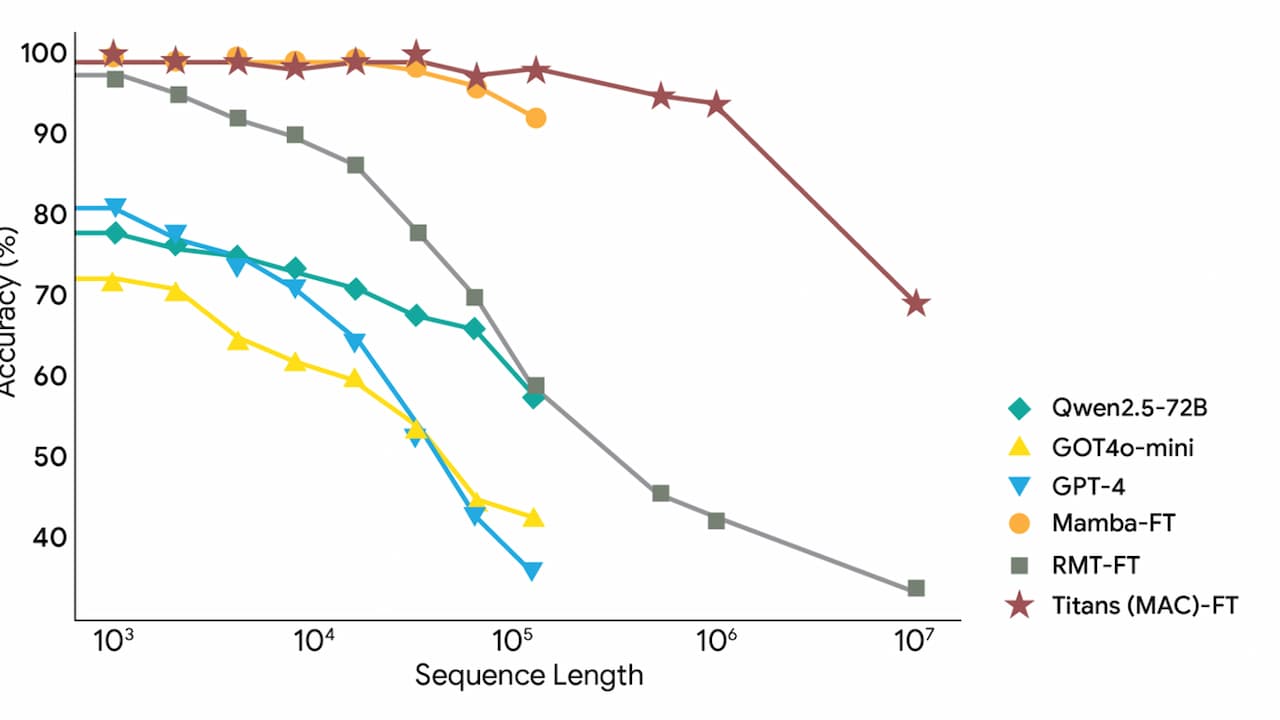

Titans ve MIRAS varyantları; Transformer++, Mamba-2 ve Gated DeltaNet gibi sektör lideri mimarilerle kıyaslanmış ve çarpıcı sonuçlar elde edilmiştir.

- Aşırı Uzun Bağlam Geri Çağırma: BABILong benchmark testlerinde Titans, GPT-4 gibi devasa modelleri, çok daha az parametreye sahip olmasına rağmen geride bırakmıştır.

- 2 Milyon Token Sınırı: Araştırmalar, Titans'ın 2 milyon tokendan daha büyük bağlam pencerelerine etkin bir şekilde ölçeklenebildiğini kanıtlamıştır.

- Genomik ve Zaman Serisi Başarısı: Titans sadece metinlerle sınırlı kalmamış; DNA modelleme (GenomicsBenchmarks) ve zaman serisi tahminleme görevlerinde de en iyi (state-of-the-art) sonuçları vermiştir.

Neden Titans ve MIRAS Geleceğin Yapay Zekasıdır?

Geleneksel modeller devasa dokümanları işlerken ya yavaşlıyor ya da bağlam penceresi dolduğunda eski bilgileri silmek zorunda kalıyordu. Titans mimarisi, bellek derinliğinin (L_M) artırılmasının karmaşıklığı azalttığını ve modelin uzun dizilerde daha "tutarlı" kaldığını göstermiştir.

MIRAS çerçevesi ise yapay zeka sıralı modelleme dünyasına teorik bir birlik getirerek; online optimizasyon, ilişkisel bellek ve mimari tasarım arasındaki kayıp halkayı tamamlamıştır. Bu, yapay zekanın sadece "not alan" bir sistemden, okuduğu hikayenin tamamını sentezleyen ve anlayan "bilge" bir sisteme dönüşmesi anlamına gelir.

AI Uzun Süreli Bellek sorununun bu şekilde çözülmesi, genomik analizlerden tam doküman hukuki incelemelerine kadar pek çok alanda uzun bağlam yapay zeka (long-context AI) kullanımını standart hale getirecektir. Google Research'ün bu devrimi, RNN verimliliğini Transformer gücüyle birleştirerek yapay zeka tarihinde yeni bir sayfa açıyor.

Yorumlar (0)

Yorum yapmak için giriş yapmalısınız.

Giriş Yap